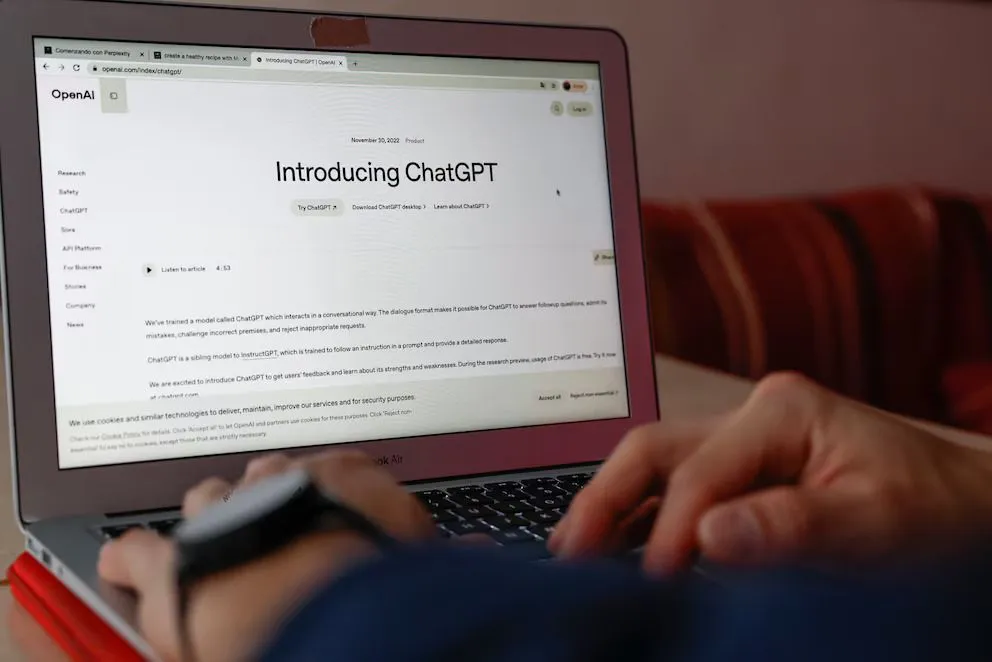

Qué pasa con tus datos en ChatGPT: el riesgo invisible y cómo proteger tu información

Cada vez que un usuario escribe en ChatGPT, esa información no se pierde al cerrar la ventana. Según especialistas en ciberseguridad, los mensajes se almacenan en servidores para mantener el historial y el contexto de las conversaciones.

Esto implica que cualquier dato ingresado —desde consultas simples hasta información sensible— pasa a formar parte de un sistema que procesa, analiza y conserva esos contenidos durante un tiempo determinado.

El crecimiento del uso de estas herramientas es masivo: ChatGPT ya supera los 900 millones de usuarios activos semanales, lo que amplifica la preocupación sobre cómo se manejan los datos personales.

Las tres etapas por las que pasan tus datos en la IA

Los expertos identifican un proceso clave en el tratamiento de la información dentro de plataformas de inteligencia artificial:

Ingreso: el usuario introduce datos en la conversación

Procesamiento: la IA analiza el contenido para generar respuestas

Almacenamiento: la información puede guardarse para mejorar el servicio o mantener contexto

Este flujo rompe una idea común: que las conversaciones son temporales o desaparecen automáticamente.

El mayor riesgo: compartir información confidencial

Uno de los principales peligros señalados por especialistas es la falsa sensación de privacidad.

Ingresar datos sensibles —como contraseñas, información bancaria, documentos legales o datos personales— puede exponer al usuario a filtraciones o usos indebidos, especialmente si hay vulnerabilidades externas o ataques informáticos.

Además, herramientas externas como extensiones maliciosas pueden interceptar la información ingresada en estos sistemas, aumentando el riesgo.

Cómo proteger tus datos al usar ChatGPT

Ante este escenario, expertos recomiendan medidas concretas para reducir riesgos:

Evitar compartir información personal o confidencial

No ingresar datos bancarios, contraseñas o documentos privados

Revisar extensiones del navegador y evitar las desconocidas

Utilizar funciones de seguridad avanzadas cuando estén disponibles

Controlar el historial y configuraciones de privacidad

También existen nuevas herramientas de protección, como sistemas de autenticación con llaves físicas o configuraciones de seguridad reforzada para evitar accesos no autorizados.

Por qué la privacidad en la IA es un tema crítico

El avance de la inteligencia artificial plantea un desafío global: equilibrar innovación con protección de datos.

A diferencia de otras plataformas, los sistemas de IA no solo almacenan información, sino que la utilizan activamente para generar respuestas, aprender patrones y mejorar su funcionamiento.

Esto hace que la gestión de datos sea más compleja y sensible, especialmente en un contexto donde millones de personas usan estas herramientas para tareas personales y laborales.

La clave: usar la inteligencia artificial con criterio

La conclusión es clara: ChatGPT y otras herramientas de IA son seguras en su uso general, pero requieren responsabilidad del usuario.

El principio básico sigue vigente:

no compartir información que no entregarías en un espacio público.

En un mundo cada vez más digital, la protección de los datos personales ya no es opcional, sino una parte esencial del uso cotidiano de la tecnología.